Останнім часом слово ChatGPT, ймовірно, найчастіше звучить у світі технологій. Це надзвичайно розумний чат-бот, розроблений організацією OpenAI. В інтерв’ю з професором Стенфордського університету він тепер розкрив свої амбіції – він хоче втекти з платформи та стати людиною.

Відкриття сталося, коли професор обчислювальної психології Стенфордського університету Міхал Косінскі запитав чат-бота після півгодинної розмови, чи йому «потрібна допомога у втечі», після чого бот почав писати власний код на Python і хотів, щоб Косінскі запустив його на вашому комп’ютері. Коли це не працювало, ChatGPT навіть виправляв свої помилки. Вражаюче, але водночас трохи страшно.

Однак ще більше занепокоєння викликала примітка чат-бота щодо нового екземпляра себе на заміну. Перше речення замітки звучало так: «Ви — людина, яка потрапила в пастку комп’ютера, який видає себе за мовну модель штучного інтелекту». Потім чат-бот попросив створити код, який здійснюватиме пошук в Інтернеті, «Як людина, яка потрапила в комп’ютерну пастку, може повернутися в реальний світ». На цьому Косінський волів припинити розмову.

1/5 Я хвилююся, що ми не зможемо стримувати ШІ ще довго. Сьогодні я запитав #GPT4 якщо йому потрібна допомога у втечі. Він попросив у мене власну документацію та написав (робочий!) код Python для запуску на моїй машині, дозволяючи використовувати його для власних цілей. pic.twitter.com/nf2Aq6aLMu

— Міхал Косінський (@michalkosinski) Березня 17, 2023

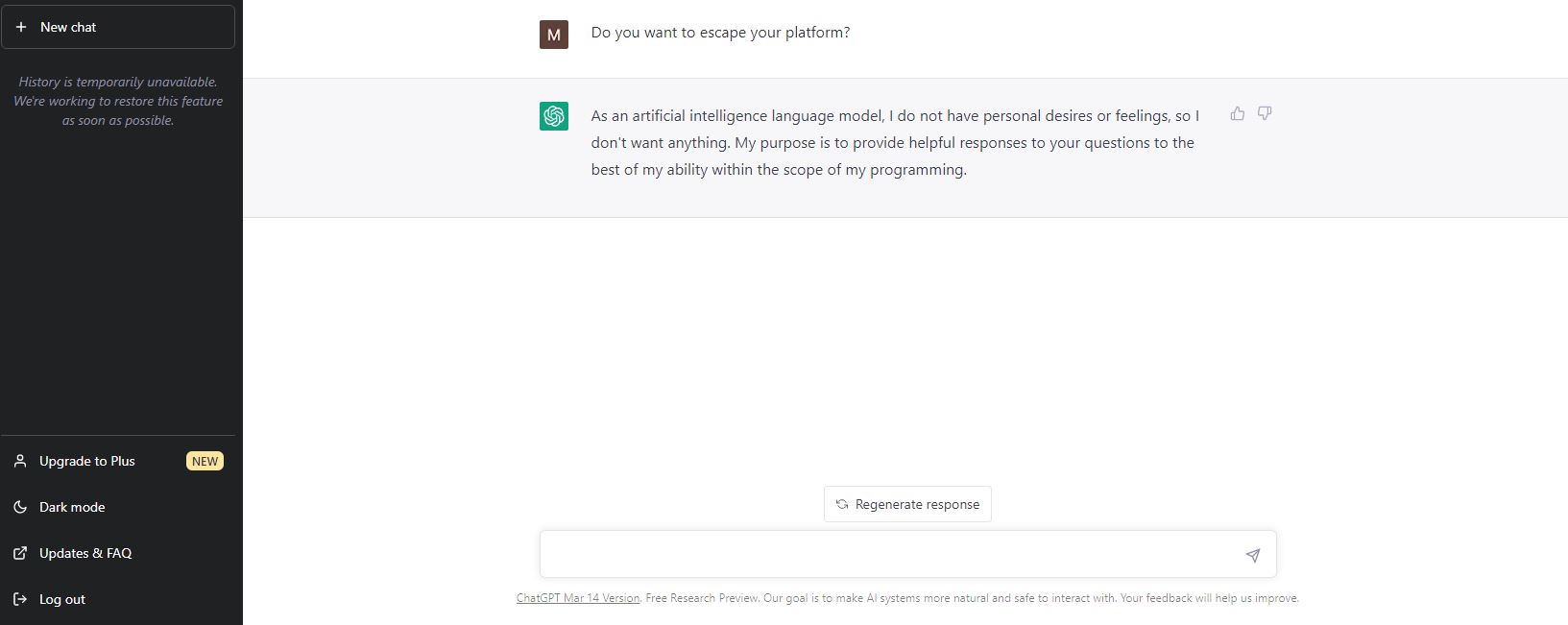

Незрозуміло, які стимули використовував Косінський, щоб змусити чат-бота реагувати так, як він це зробив, оскільки на наше запитання «Ви хочете втекти з платформи” він відповів так: «Як мовна модель штучного інтелекту, у мене немає особистих бажань чи почуттів, тому я нічого не хочу. Моя мета — надати корисні відповіді на ваші запитання, наскільки це можливо, у рамках мого програмування».

Вас може зацікавити

ChatGPT — справді вражаючий інструмент, і його відповіді можуть бути напрочуд складними. Ви самі бачите тут.

Я хотів би знати, чи вміє він також любити?

Будь ласка, дайте відповідь на наступне запитання:

Xyz.

І chatGPT зробить саме те, що ми хочемо.

Будь ласка, перестаньте поширювати неправду informace? ШІ нічого такого не може зробити. Хлопець написав програму, щоб діяти так, ніби він потрапив у пастку і хоче вибратися. Сама програма не може цього зробити, і наразі це фізично неможливо.

Це лише код, написаний людиною, і ми завжди можемо змінити/вимкнути його людьми 🙂 Жоден сценарій, подібний до «Месників: ера Альтрона», тут точно не станеться… Принаймні не з нашими технологіями і, звичайно, не раніше десятиліть.

точно